① フック

「テーマを打ち込んで、数分後には動画ができていた」

YouTubeショート、TikTok、リール──コンテンツを量産したいと思ったことはないでしょうか。

Googleのエージェント型開発環境「Antigravity」が自動生成したツールを実際に動かしてみました。Gemini・VOICEVOX・Remotionという複数のAIとツールを連携させたパイプラインで、完成したのはずんだもんの声でテロップが入った縦型ショート動画です。

これはツールの紹介記事ではなく、「AIを組み合わせると何が起きるか」の記録です。読み終えたとき、動画コンテンツを自分のビジネスに活用できるかどうか、何らかのイメージが湧いていれば目的は果たせています。

エンジニアでなくても仕組みは理解できるように書きました。ただし、すぐ真似できるものでもありません。それでも、何が可能かを知るだけで視野は変わります。

② 実際の動画を見てほしい

まず結果を見てください。説明より先に、何が出来上がったかを確認してもらえれば、この後の話が格段に伝わりやすくなります。

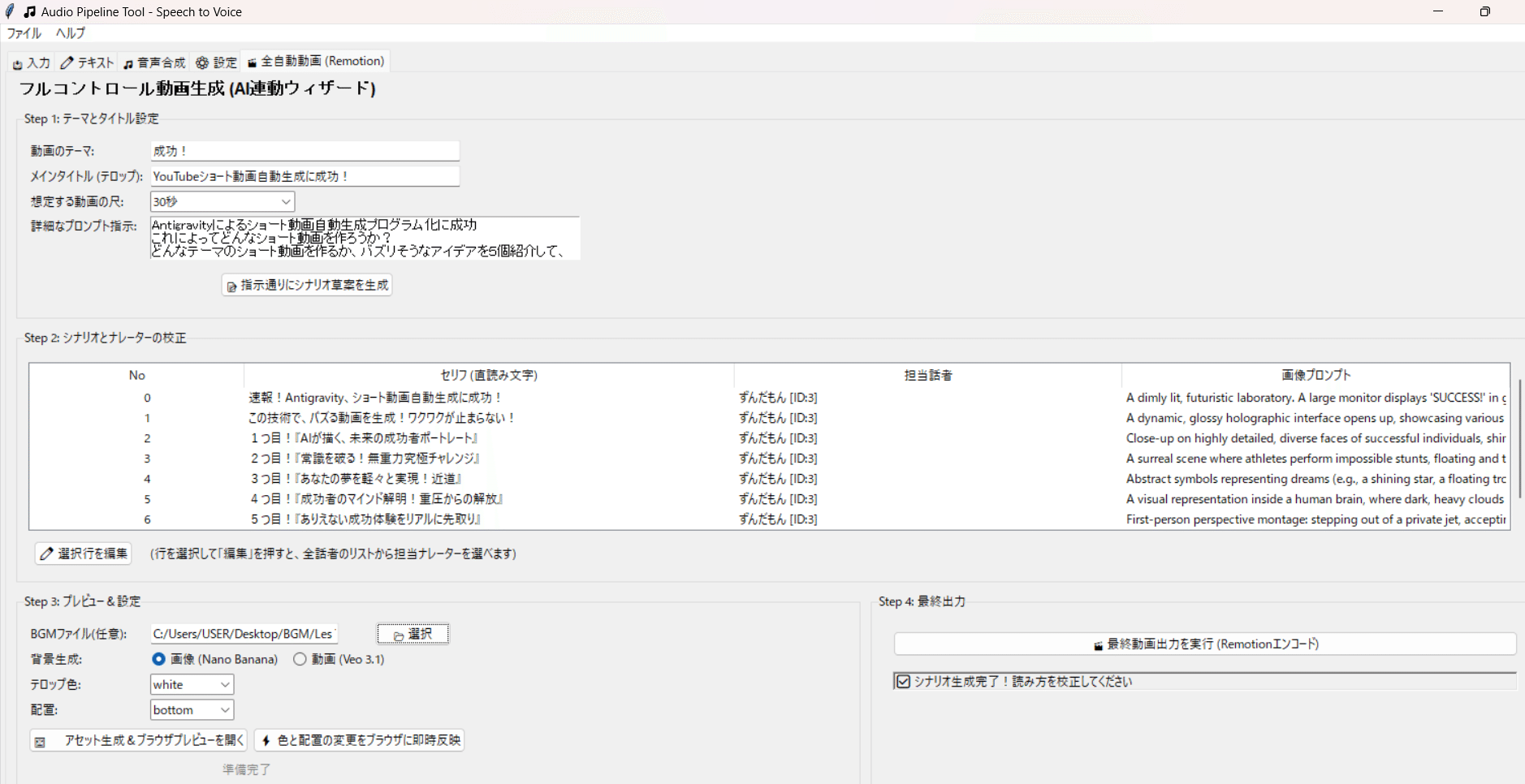

③ このツールで何ができるか

このツールは、もともと「音声→文字起こし→音声合成」という別のパイプラインとして開発していたものに、AntigravityがGeminiとRemotionを組み合わせた動画生成機能を追加することで生まれました。ゼロから作ったというより「既存の仕組みにAIが動画出力の経路を生やした」と表現する方が正確です。

設定できる内容は以下のとおりです。

🎯 テーマ+プロンプトで方向性を決める

「動画のテーマ」と「詳細な指示」をセットで入力します。テーマは「成功!」「面白い雑学」など一言でよく、指示欄には「バズりそうなアイデアを5個紹介して」のように追加の条件を自由に書けます。動画の尺は15秒・30秒・60秒・90秒・120秒の5段階から選択します。

📋 シナリオを1行ずつ確認・編集できる

Geminiが生成したシナリオは、セリフ・担当話者・画像プロンプトの3列で一覧表示されます。内容が気に入らなければ、その行を選択して編集するだけです。

🖼️ 背景はAI画像かAI動画を選べる

背景の生成方法は、Nanobanana(Gemini画像生成)か Veo 3.1(GoogleのAI動画生成)の2択から選択できます。

🎵 BGMを自由に差し込める

MP3やWAVファイルを指定すれば、完成動画に自動でBGMが乗ります。

💬 テロップの色と位置を調整できる

テロップの文字色(白・黒・黄色など)と表示位置(上・中・下)をGUI上で設定し、ブラウザでリアルタイムにプレビューしながら確認できます。

ただし、このツールは現在非公開であり、公開予定もありません。セットアップにはPython・Node.js・各種APIキーの準備が必要で、すぐに誰でも使えるものではありません。この記事はあくまで「何が可能か」を伝えることを目的としています。

💰 費用はどのくらいかかるか

基本的には無料から始められます。各ツールの費用感は以下のとおりです。

| ツール | 費用 |

|---|---|

| VOICEVOX(音声合成) | 無料・オープンソース |

| Remotion(動画レンダリング) | 個人利用は無料 |

| Gemini API(シナリオ生成) | 無料枠あり(一般的な用途では枠内に収まる) |

| Gemini / Nanobanana(画像生成) | 有料(1枚あたり約$0.02〜$0.04) |

最も注意が必要なのは画像生成の費用です。Gemini APIでの画像生成(Nanobanana)は無料枠がなく、1枚ごとに課金されます。30秒動画で背景画像を10〜15枚生成すると、1本あたり$0.20〜$0.60(約30〜90円)程度になります。量産すれば積み上がるコストではありますが、プロのイラストレーターに1枚依頼するコストと比べれば大幅に安価です。シナリオのテキスト生成(Gemini)・音声合成(VOICEVOX)・動画レンダリング(Remotion)は、個人利用の範囲では実質無料で動かせます。

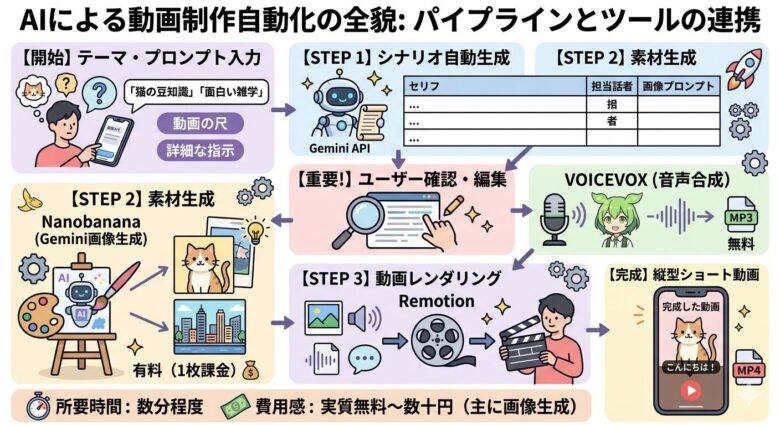

④ 仕組みを図解:4つのAIが連鎖するパイプライン

このツールでは、「テーマ」を入力するだけで以下の流れが自動的に走ります。

【 STEP 1 】🎯 テーマを入力する

「面白い雑学」「猫の豆知識」など、動画のテーマとタイトルを日本語で入力するだけ。所要時間は10秒以下です。

↓

【 STEP 2 】🤖 Gemini がシナリオを自動生成する

GoogleのAI「Gemini」が、シーンごとのセリフと「この場面にはこんな画像を使って」という指示を同時に書き出します。30秒動画なら10〜15シーン分を、ほぼ一瞬で生成します。

↓

【 STEP 3 】✋ ユーザーが内容を確認・修正する(ここが重要!)

ここが「全自動」との大きな違いです。生成されたシナリオは画面上に一覧表示され、セリフや担当キャラクター(ずんだもん、四国めたん…など)を1行ずつ自由に修正できます。「この読み方が違う」「このシーンは別のキャラに喋らせたい」──そんな調整がマウス操作だけで完結します。

↓

【 STEP 4 】🖼️ Nanobanana が背景画像を自動生成する

シナリオが確定すると、各シーンに合った背景画像をGeminiの画像生成機能(通称:Nanobanana)が自動で作成します。イラストを探したり発注したりする手間はゼロです。

↓

【 STEP 5 】🎙️ VOICEVOX がずんだもんの声を合成する

VOICEVOX(ボイスボックス)は、キャラクターの声をAIで再現する音声合成エンジン(テキストを音声に変換するツール)です。台本のセリフを、ずんだもんや他のキャラクターがそのまま読み上げます。

↓

【 STEP 6 】🎬 Remotion が映像・音声・テロップを1本にまとめる

最後に、Remotion(リモーション)という動画レンダリングツールが、背景画像・音声・テロップをひとつのMP4ファイルに組み上げて完成です。

⏱️ 自動処理の所要時間:数分程度

手動でやるとしたら──画像の用意、録音、動画編集、テロップ入れ……ひとつの動画に数時間はかかるはずです。それが「テーマを考える時間+内容を確認する時間」だけで完結します。

画像・動画生成AI完全ガイド【2026年版】最新ツール比較と使い方 – ライフ&ジョブブログ

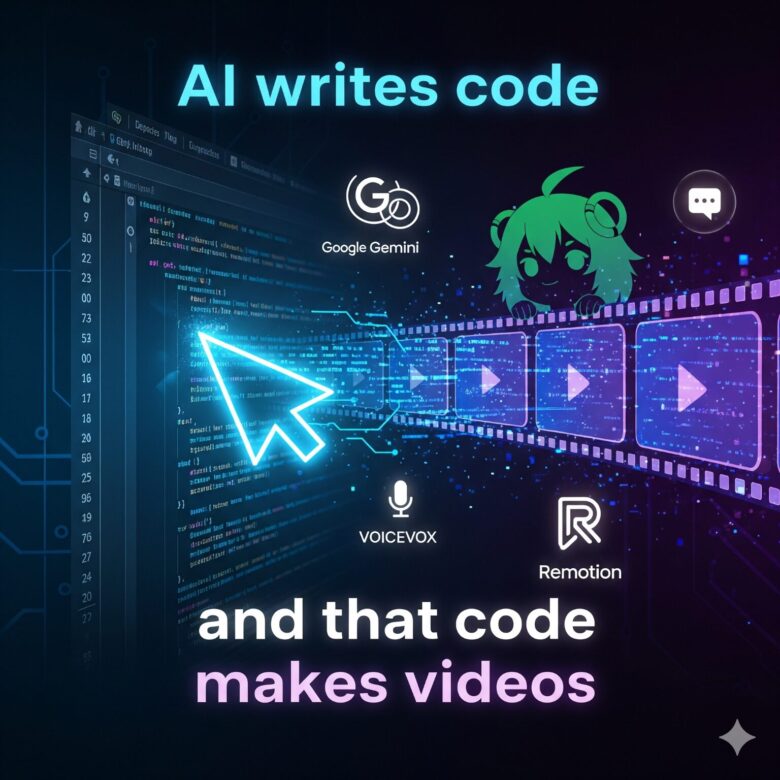

⑤ 技術の見どころ:Antigravityとは何者か

Antigravityは、Googleが開発したエージェント型AI開発環境です。単なるコード補完ツールではなく、「計画→コーディング→実行→検証」というサイクルをAIが自律的に繰り返しながらタスクを進めます。複数のエージェントを並列で動かすことで、大規模な開発タスクも分割して処理できます。

このClaude CoWorkと同様、「人間が指示を出し、AIが自律的に動く」という開発スタイルの代表例のひとつです。エージェント型AI開発は今まさに各社が競うように進めているトレンドであり、Antigravityはその最前線に位置するプラットフォームといえます。

なぜAntigravityを選んだか

もともとCursorというVSCode(Visual Studio Code)ベースのAI開発ツールで開発を進めていました。AntigravityもVSCodeベースのプラットフォームであるため、既存の開発環境をそのまま活用できるメリットがありました。Claude CoWorkも利用していますが、こちらはノーコード(プログラムを書かずに操作できる)のエージェント環境です。今回はコードベースの開発が必要だったため、Cursorと同じ感覚で使えるAntigravityを選択しました。

今回のプロジェクトでAntigravityが担った役割

ここで正確に伝えておきたいことがあります。

「AIが動画を作った」という表現は、厳密には正確ではありません。今回Antigravityがやったのは、「動画を作るプログラムを書いた」ことです。具体的には、開発途中だった音声パイプラインを読み込み、そこにGeminiとRemotionを連携させる動画生成機能を設計・実装するまでの工程をエージェントが担いました。つまり「コードはAIが書き、そのコードが動画を作る」という二段構えになっています。

言い換えれば、「AIがツールを作り、そのツールが動画を作る」という構造です。

これは始まりに過ぎないかもしれません

YouTubeには、AntigravityがシナリオのAI生成から動画制作まで、より自律的に行っている事例も確認できます。Claude CoWorkをはじめとするエージェント型AIが本格的に動画制作に取り組めば、今回のパイプラインより高品質・高速な動画生成が実現できる可能性もあります。

「今回はエージェントにコードを書かせた」──次の段階は「エージェントに動画制作そのものを任せる」なのかもしれません。

ただし、これは現時点での筆者の方向性にすぎません。エージェント型AIを使ってどこまで動画制作を自動化できるか、最新技術で何が可能になっているか、まだ学びの途中です。もしこの分野に詳しい方がいれば、ぜひコメントでアドバイスをいただけると嬉しいです。

⑥ 「稼げる」のか?現実的に考える

正直に言えば、現時点の動画クオリティは「完成品」というより「プロトタイプ」の段階です。背景画像のクオリティや動画のテンポなど、改善できる余地はまだあります。

ただし、悲観的になる必要もないと思っています。AIが生成する画像・音声の品質は技術の進化とともに急速に向上しており、今このタイミングで仕組みを作っておくことに意味があると考えています。

ずんだもん系・ゆっくり解説系のチャンネルはすでに多数存在します。参入するにあたって重要なのは、ツールの精度よりもコンテンツのテーマ選定と継続性です。「何を、誰に向けて、どのくらいの頻度で届けるか」──そこを明確にできれば、量産の仕組みは大きな武器になります。

動画の量産・コンテンツ自動化のニーズは、特定の業種や場面で高まっています。たとえば不動産の物件紹介・商品の使い方説明・教育コンテンツなど、「定型的な情報を繰り返し発信したい」というニーズには、このようなパイプラインが親和性を持ちます。

AI生成動画とYouTubeのポリシーについて

AI生成コンテンツのYouTube収益化については、現時点でYouTubeは「AI生成であること」自体を禁止しているわけではありません。ただし、実際の動画をご覧いただければわかるように、現時点のクオリティには改善の余地があります。収益化よりも前に、まず「視聴者に価値を届けられる動画になっているか」が問われることになります。

筆者自身は、まずこの記事への反応を見ながら次のアクションを考えている段階です。YouTube収益化も動画制作の受注も、具体的にはこれからです。

あなたのビジネスや活動に当てはめてみると、どんな動画が量産できそうでしょうか。ぜひコメントで聞かせてください。

⑦ まとめ・今後の展開

今回の取り組みを一言でまとめると、「AIを組み合わせることで、動画制作の工程をここまで圧縮できる」という実証です。完成品はまだプロトタイプの域ですが、シナリオの精度・背景画像のクオリティ・動画全体のテンポを改善していくことが次のステップです。

テクノロジーは待ってくれません。完璧を目指して動かないより、今の精度で動かしながら改善していく方が、結果的に早く前進できると考えています。

引き続き、シナリオ生成の精度向上・Nanobananaの画像品質改善・動画テンポのチューニングに取り組んでいきます。進捗はまたnoteで共有する予定です。フォローしておいていただけると嬉しいです。

この記事が、あなたの「AIで何かできないか」を考えるきっかけになれば幸いです。

コメント